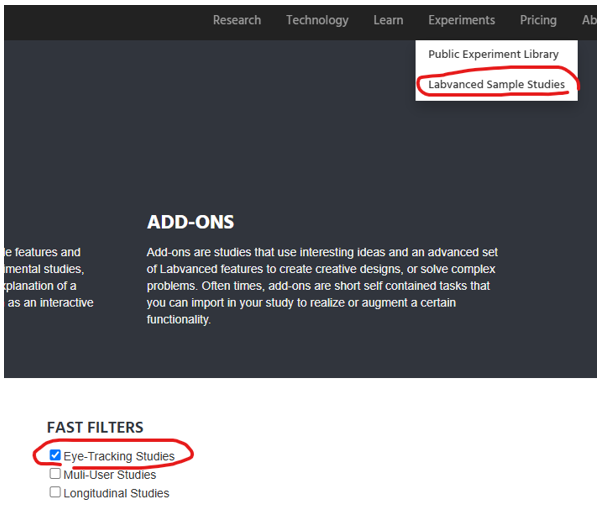

有志が共有したプログラム「Public Experiment Library」と公式の「Labvanced Sample Studies」があるので、後者を選択し、さらに、FAST FILTERSで Eye-Tracking Studiesにチェックを入れます。

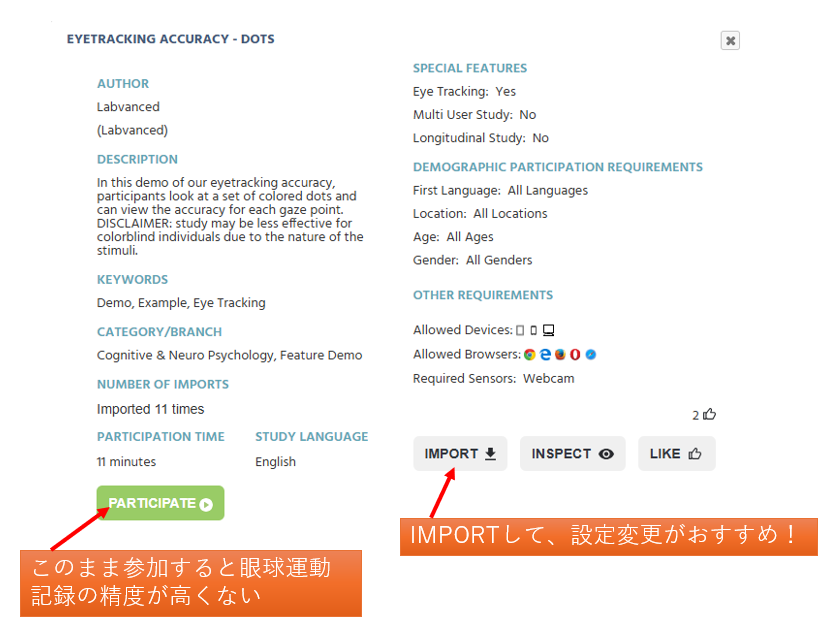

どのプログラムでもよいのですが、

- DEMOS -> Eyetracking Accuracy – Dots はリアルタイムで精度を体感できる

- DEMOS -> Eye Tracking Demo – SVGs as AOIs は特定の範囲(Area of Interest)を見たときの眼球運動を記録できる

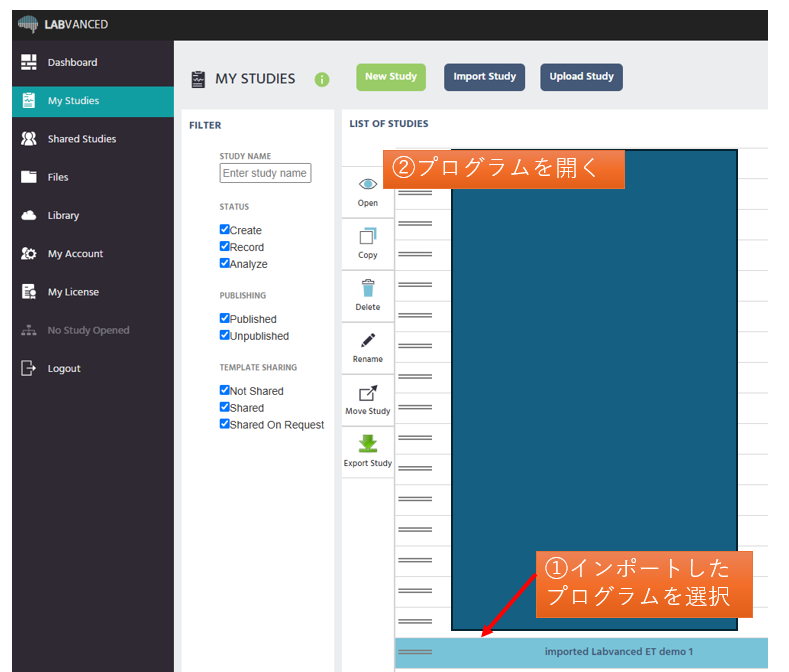

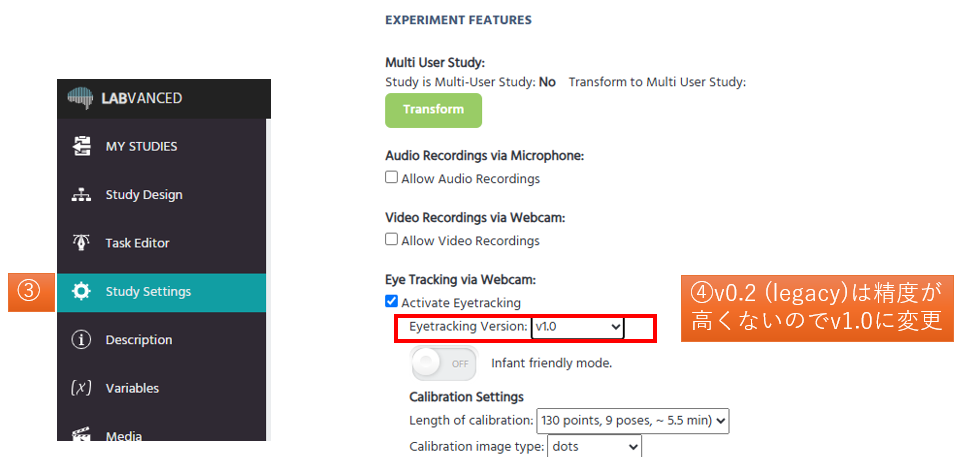

のでお勧めです。プログラムを選択して、PARTICIPATEでもよいのですが、実はこのままだと精度が高くありません。PARTICIPATEではなく、importをして、Eyetracking Version を v1.0に変更したほうがよいです。

ウェブカメラの使用を許可する必要があるので注意!

眼球運動を計測する実験プログラムの作成に興味のある場合はこちらをご覧ください。

SVGについて

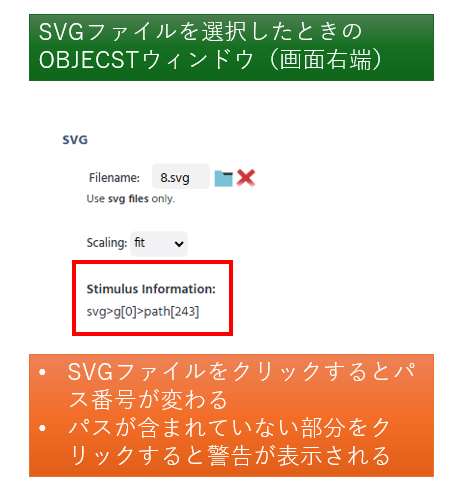

Eye Tracking Demo – SVGs as AOIs で使われているSVGというのは、Scalable Vector Graphics の略で、2次元ベクターイメージ用の画像形式の1つです。私も詳しくないのですが、このデモプログラムでは人物の写真(SVGファイル)をAOIとして、さらに人物の写真の中にパス情報が含まれています。こうすることで、人物の写真を見ているときに、さらにその写真のどの部分を見ているのかという細かいことまで記録することが可能になります(もちろん眼球運動が正確に記録できていることが大前提となります)。

公式の解説ページを開いて、一番下の画像を見てください(画像をクリックすると拡大表示されます)valueの列に、例えば次のように記録されています。

svg > g[0] > g[1] > path[4]

画像(SVG)ファイルに含まれる多数のパスのうち、ここでは path[4]を見たことになります。

サンプリング周波数

公式サイト(最後のほう)によれば、2025年2月現在、最大30Hzとあります。市販のウェブカメラのサンプリング周波数が30Hzであるということも大いに関連があります。